DeepMind公布其正在开发一套创新的音频生成技术细节,也就是NbLM背后使用的语音技术。使AI能够生成更加自然的对话和高质量的音频。这些技术不仅提升了语音助手的交互性,还帮助多种应用在语音合成和对话生成上取得更大进展。 1.核心音频生成技术

1.核心音频生成技术

SoundStream:它能够高效地将音频压缩成一组声学令牌(tokens),然SoundStream是一个神经音频编码器后解码出接近原始音频的高保真声音这是一种AI技术,它能够把一段音频压缩成一组小的“音符”(被称为声学令牌),然后再解压缩成高保真音频。

这个过程类似于把一段语音“翻译”成数据,然后再“翻译”回来。声学令牌是音频的数字表示,它们携带语音的各种信息,如语调、节奏和声音细节。这些令牌类似于文本模型中的词汇,帮助AI生成自然语音。

AudioLM :AudioLM将音频生成视为一种语言建模任务,即将音频生成类比于文本生成。通过处理这些声学令牌,它不需要为不同类型的声音进行模型调整,可以灵活地生成多种类型的音频。可以将生成语音看作生成文字的类似过程。它像GPT这样的文本模型一样工作,但处理的不是单词,而是声音数据。这项技术能够生成多说话人对话,而无需为每个说话人调整模型,

SoundStorm:SoundStorm是DeepMind开发的一个多说话人对话生成模型,能够生成多达30秒的自然对话段落。它进一步发展了AudioLM和SoundStream的基础技术,能够根据不同说话人的标记生成更长更自然的对话。可以生成多个人之间的对话,而不是一个人独白。例如,AI可以模拟一场访谈,两个虚拟人物有问有答,看起来像是“现场”对话。

2.最新的音频生成技术

DeepMind的新一代音频生成模型能够生成长达2分钟的对话,并且保持高质量的音频输出。这项技术通过以下方式实现改进:

更快的生成速度:该模型在3秒内即可生成2分钟的对话,速度比实时生成快40倍

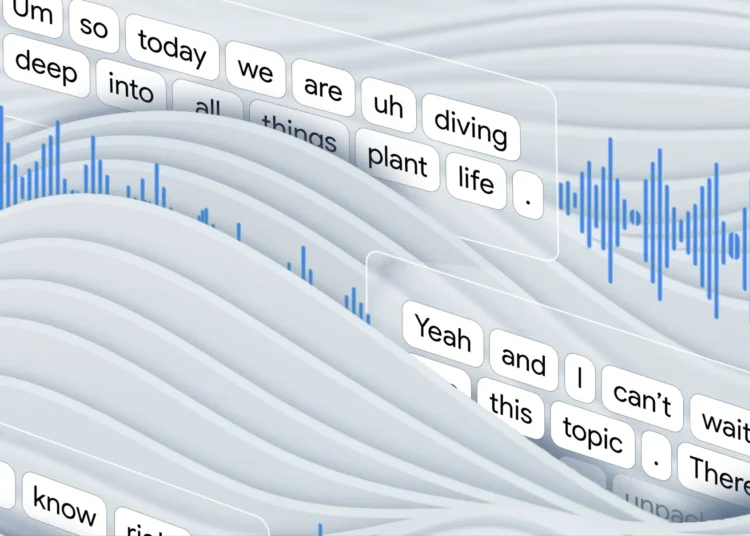

自然的对话流:模型能够保持说话人之间的连贯切换,输出语音中还包括自然的停顿、口头语(如“嗯”、“啊”)等细节,使得生成的对话更接近真实交流。

高效的计算架构:利用新的Transformer架构,模型能够处理更长的音频席列,同时保持高效的推理过程。这些音频序列以自回归方式生成,意味着模型会逐步生成音频内容,确保准确性和致性。

3.多层次的音频压缩与处理新的语音编码技术可以把音频压缩到600 bps(比特每秒),比以前的技术更高效,但仍能保持清晰的音质。生成的“音符”分为多层次,每一层代表不同的语音信息

第一层:包含基本的语音信息,比如语调和节奏,

后续层次:包含更细致的声音细节,比如声音的音色和细腻的发音,

4.训练方法和数据集大规模预训练:

模型通过数十万小时的语音数据进行预训练,学习如何生成基础的语音结构。高质量对话微调:为了让模型生成更自然的对话,DeepMind还使用了小规模的高质量对话数据集进行微调。这个数据集包含真实对话中的细微特征,如非剧本对话、自然停顿和真实的语音变化。

5.模型的潜在应用“DeepMind的音频生成技术正在应用于多种Google产品和实验项目,如:

YouTube自动配音:用AI自动为视频生成多语言的配音。以前的配音可能很平淡,但新的技术能让AI配音听起来更真实。

NotebookLM音频概述:这是一种新功能,能把,文档内容转成两个AI角色的对话形式,像是在听一场讨论会。

教育和普及内容:通过将复杂的研究论文或文章转化为自然的对话形式,让人们更轻松地理解。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

暂无评论...